Datenkompression / Datenkomprimierung

Einschätzen von Datenkompressionsverfahren

Datenkompression (auch Datenkomprimierung) spielt in Zeiten stark wachsender Datenmengen, Cloud-Nutzung und vernetzter Systeme eine zentrale Rolle. Unternehmen setzen Kompressionsverfahren ein, um Speicherressourcen effizienter auszuschöpfen, Übertragungszeiten zu verkürzen und damit Kosten zu reduzieren – z. B. beim Versand großer Dateien, in Datenbanksystemen, bei Backups oder in der Langzeitarchivierung. Je nach Einsatzzweck kommen verlustfreie Verfahren (Originaldaten bleiben exakt rekonstruierbar) oder verlustbehaftete Verfahren (gezielte Qualitätsreduktion, typischerweise bei Multimedia) zum Einsatz.

Was bedeutet Datenkompression?

Bei der Kompression wird die Datenmenge durch Kodierung reduziert; bei der Nutzung werden die Daten wieder dekodiert (dekomprimiert). Ziel ist eine kleinere Darstellung bei ausreichender Qualität bzw. vollständiger Wiederherstellbarkeit - abhängig vom Anwendungsfall.

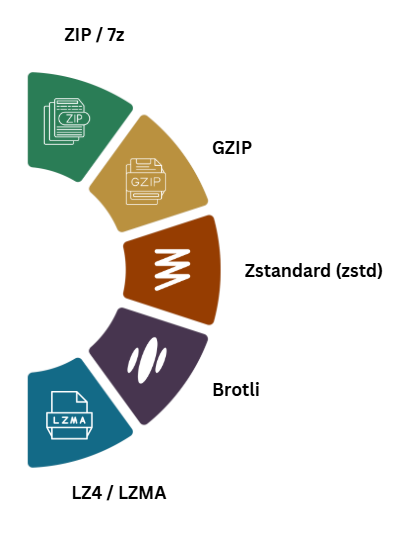

Wichtige Verfahren und Formate im Überblick

Verlustfreie Kompression (ohne Informationsverlust)

Typische Einsatzfelder sind Archivierung, Datenaustausch, Backups sowie technische Daten (Dokumente, Logfiles, Datenexporte).

- ZIP / 7z: verbreitet für Dateiarchive und Austausch

- GZIP: häufig in Server-/Web-Umgebungen und bei Datenpipelines

- Zstandard (zstd): sehr gutes Verhältnis aus Kompressionsrate und (De-)Kompressionsgeschwindigkeit; verbreitet in Server-, Cloud- und Storage-Szenarien

- Brotli: optimiert für Webinhalte; häufig für HTTP-Übertragung eingesetzt

- LZ4 / LZMA: LZ4 für hohe Geschwindigkeit, LZMA für hohe Kompressionsraten (oft bei Archiven/Distributionen)

Verlustbehaftete Kompression (mit Qualitätsverlust)

Typisch für Bild, Audio und Video – überall dort, wo eine kleinere Datenmenge wichtiger ist als exakte Wiederherstellung.

- Bilder: JPEG, (teils auch) AVIF

- Audio: MP3, AAC

- Video: MP4/H.264, HEVC/H.265, AV1-basierte Formate

Aktuelle Entwicklungen und Trends

Zstandard und moderne „Speed/Ratio“-Optimierung

Zstandard wurde für „Real-Time“-Szenarien entwickelt und bietet eine breite Skala an Kompressionsstufen – von sehr schnell bis sehr kompakt. Zudem ist das Format als IETF-RFC dokumentiert, was die Integration in Systeme und Protokolle erleichtert.

Brotli als Baustein moderner Web-Performance

Im Webumfeld wird Kompression häufig über HTTP-Mechanismen wie Content-Encoding umgesetzt; Brotli ist dafür ein etabliertes Verfahren (neben gzip).

KI-gestützte Kompression (insbesondere bei Bildern/Video)

Neben klassischen Algorithmen gewinnen lernbasierte Ansätze an Bedeutung. Der JPEG-Ausschuss berichtet z. B. über JPEG AI als lernbasierte Bildkompression mit spürbaren Effizienzgewinnen gegenüber etablierten Verfahren. Für Unternehmen ist das vor allem dort relevant, wo sehr große Bildbestände, Medien-Workflows oder bandbreitenkritische Anwendungen im Fokus stehen.

Datenkompression in Softwareanwendungen und der Unternehmenspraxis

Viele Softwarelösungen integrieren Kompressionsmechanismen direkt in ihre Prozesse – u. a.:

- Backup- und Archivierungssoftware (Backup-Sets, Deduplizierung + Kompression, Langzeitaufbewahrung)

- Content-Management und DMS/ECM (Dokumente, Versionierung, Medien)

- Datenbanken und Data-Warehouse/Analytics (Tabellen-/Index-Kompression, spaltenorientierte Speicherung)

- Business-Intelligence- und ETL/ELT-Prozesse (komprimierte Austauschformate, effizientere Pipelines)

Gerade in Datenbanken beeinflusst die Komprimierung nicht nur den Speicherbedarf, sondern auch Performance (CPU/IO-Balance), Wartungsfenster und Kosten. Beispiele:

- Microsoft SQL Server unterstützt u. a. Row-/Page-Kompression sowie Columnstore- und Archivkompression.

- PostgreSQL bietet Kompression u. a. im TOAST-Mechanismus (z. B. LZ4) und unterstützt zusätzliche WAL-Kompressionsoptionen (u. a. zstd/lz4, abhängig von Build/Version).

- Oracle adressiert Datenreduktion im Enterprise-Umfeld über Advanced-Compression-Funktionalitäten.

Praxis-Tipp: Prüfen Sie vor Einführung oder Migration, wie Kompression umgesetzt wird (Algorithmus, Stufen, Dictionary-Support, spalten-/seitenweise vs. dateibasiert) und welche Stellschrauben es für Ihre Workloads gibt (z. B. Reporting vs. Transaktion, „hot“ vs. Archivdaten).

Datenkompression in Cloud-Umgebungen

Kompression kann Cloud-Kosten in zwei Richtungen beeinflussen:

- Speicherbedarf reduzieren (weniger Objekt-/Block-/Tabellengröße – je nach Dienst und Daten)

- Datenübertragung reduzieren (geringere Transfermengen, schnellere Bereitstellung, potenziell weniger Egress/Traffic)

Wichtig ist die Unterscheidung: Objekt-Speicher komprimiert Ihre Daten nicht automatisch „magisch“ – häufig wird Kompression vor dem Upload oder innerhalb von Diensten (z. B. CDN/Delivery, Data Warehouse-Formate) realisiert.

Beispiele für serverseitige/edge-nahe Kompression:

- Amazon CloudFront kann Objekte automatisch komprimieren (gzip/Brotli).

- Azure Front Door unterstützt Kompression (gzip/Brotli) unter definierten Bedingungen.

Ein anschauliches Beispiel für datenformatbasierte Kompression im Analytics-Kontext: Backblaze zeigt, wie ein Dataset im spaltenorientierten Format Parquet gegenüber CSV massiv schrumpfen kann, was nicht nur Speicher-, sondern auch Abfrage- und Compute-Aufwände beeinflussen kann.

Nachhaltigkeit und Energieeffizienz

Kompression kann indirekt zur Effizienz beitragen, weil weniger Daten gespeichert und übertragen werden müssen. Gleichzeitig entsteht zusätzlicher Rechenaufwand für (De-)Kompression, der Nettoeffekt hängt stark von Datenart, Hardware und Nutzungsmuster ab. Studien untersuchen diesen Zusammenhang z. B. für energiebegrenzte Systeme und Übertragungsszenarien.

Checkliste: Worauf sollten Sie bei Softwarelösungen achten?

Wenn Sie Software auswählen oder bestehende Systeme optimieren, helfen u. a. diese Fragen:

- Welche Verfahren/Algorithmen werden unterstützt (z. B. gzip, zstd, brotli, LZ4)?

- Konfigurierbarkeit: Kompressionsstufen, Dictionary-Optionen, Auswahl je Datentyp/Partition/Archivklasse

- Performance-Auswirkungen: CPU-Last vs. IO-Einsparung, Einfluss auf Restore/Recovery und Abfragen

- Kompatibilität: Austauschformate, Integrationen, Langzeitlesbarkeit (Standards/RFCs)

- Sicherheit: Kompression ersetzt keine Verschlüsselung; Reihenfolge und Prozesse (z. B. komprimieren vor verschlüsseln) sauber definieren

- Betriebsaspekte: Monitoring, Kapazitätsplanung, Backup-Fenster, Cloud-Transfer/egress

Weiterführende Informationen

Definition und Grundlagen: Wikipedia „Datenkompression“

Übersicht über Tools/Formate: Wikipedia Datenkompressionsprogramme.